¿Qué es eso del artículo 13 y por qué mis hijos temen no poder seguir viendo a sus youtubers favoritos?

.- Mamá, mamá, pero ¿qué eso de que El Rubius ya no va a poder seguir poniendo videos? ¿Por qué dice Jaime Altozano que puede que tenga que cerrar su canal?

.- ¡¡Mamá, dice mi canal de booktubers que hay una ley que hace que a lo mejor ya no puedan recomendarme más libros!!

Tengo un adolescente, una pre-adolescente y un niño en casa. Los tres ven YouTube, buscan en Google y Wikipedia. Ninguno está en Facebook, pero alguno sí en Instagram. Los tres me han hablado ya sobre “el artículo 13, mamá, el artículo 13”. Por ellos, y por mí -porque yo misma creo contenidos y no tengo claro qué pasa si un día hago referencia a contenidos de otros u otros usan mis contenidos-, he aquí un post 😉

La Directiva sobre Derechos de Autor en el mercado digital

El Parlamento Europeo aprobó hace tres meses la propuesta de Directiva sobre derechos de autor, con el fin de “intentar adaptarse a la evolución de las tecnologías digitales”. Después de más de 200 enmiendas durante los últimos dos años, el texto debe ser aún aprobado de manera definitiva. La polémica que acompaña a esta norma es enorme. De un lado están quienes la defienden -discográficas y medios de comunicación tradicionales- y de otro los gigantes de Internet, los ciberactivistas del movimiento #saveyourinternet, los sectores audiovisual y deportivo, asociaciones de consumidores, start-ups y expertos del sector de la tecnología y del derecho a la propiedad intelectual, que rechazan el contenido de la actual redacción de la directiva porque “otorga a las plataformas digitales la labor de ser ‘policía y juez’ de los contenidos protegidos que se suben a Internet”.

Según el texto propuesto hasta el momento por el Parlamento Europeo, las plataformas tendrán que velar por que el contenido que alojan no suponga violaciones de copyright. Servicios como Facebook, Twitter, Wikipedia, YouTube o Instagram tendrán que adoptar medidas y usar técnicas de reconocimiento de contenidos para bloquearlos antes de que lleguen a estar disponibles. Hasta ahora, para que se diera la situación de borrar un contenido, debía existir una notificación del titular de los derechos, pero no se monitorizaba la subida de este tipo de contenidos. Con esta nueva ley, las grandes plataformas deberán monitorizar el contenido a escala masiva y detectar posibles infracciones a riesgo de sanción.

Así que con la redacción actual, toda la responsabilidad es de las plataformas –lo cual es muy cómodo para el usuario, por cierto, pero ¿dónde queda la responsabilidad de las acciones de cada uno?-. Los millones de fotos, textos y vídeos que se suben cada día a Internet serían con esta Directiva objeto de escrutinio permanente por parte de algoritmos de inteligencia artificial, pues es la única opción que permite la nueva norma. Si alguien utiliza mis contenidos, o si yo utilizo los contenidos de otro, parece que ya no hará falta denuncia probada de por medio ni mucho menos la decisión de un juez ante la supuesta prueba de una vulneración de derechos. La decisión la tendrían las tecnológicas. ¿No es eso darles todo el poder? ¿Entonces de qué nos quejamos luego?

En fin. Por todo esto, seguro que últimamente, cuando entras en YouTube, ves un aviso como éste:

Y por eso, si tienes en casa adolescentes que siguen a youtubers, quizá te hayan comentado algo sobre lo preocupados que están porque quizá esos youtubers ya no puedan publicar el mismo contenido que hasta ahora, o quizá sea más difícil seguir a youtubers o influencers de fuera de Europa si la Directiva se aprueba tal y como está redactada ahora. Y si tienes iKids a los que les gusta componer, dibujar o editar video, o crear recomendaciones sobre libros molones, y que utilizan Internet para compartir lo que hacen, tendrás que decirles que con esta Directiva tendrían que tener mucho, mucho cuidado si lo quieren seguir haciendo.

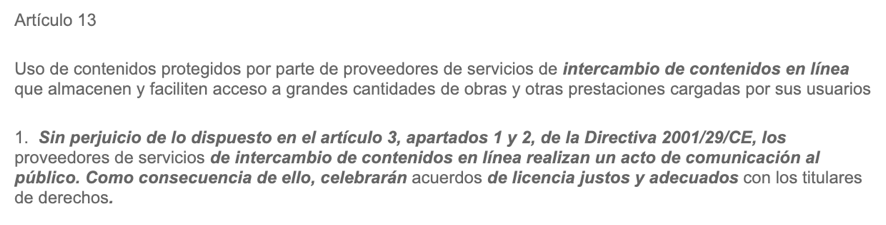

La clave, el nitty gritty, el temita, está en el artículo 13, en su versión de septiembre de este año.

Esto lo que viene a decir es que se responsabiliza al cien por cien a las plataformas tecnológicas tecnológicas de lo que compartan los usuarios -desde los youtubers hasta nuestros hijos-. Para ello, se les fuerza a hacer filtrados, implantar medidas técnicas (fundamentalmente algoritmos) y reconocer los contenidos que los usuarios suben a Internet , para bloquearlos en los casos en los que se puedan estar vulnerando los derechos de autor.

Y todos aquellos que suban a YouTube o Facebook, por ejemplo, videos de gameplay (retransmisión de partidas de Fortnite, por ejemplo), todos los que hagan videos con unboxing –abrir paquetes- o que hagan reviews–de una peli, de un libro, de una banda sonora-, tendrán que olvidarse de seguir haciendo lo mismo, porque podrían ser objeto de ese bloqueo. Sus contenidos nunca son 100% originales porque suelen recurrir a música o imágenes de terceros y el algoritmo puede identificarlo erróneamente si no distingue la cita o la parodia, por ejemplo.

Y los que suben contenidos a YouTube o Instagram con creaciones originales –sus pelis, sus cortos, sus bailes, sus tutoriales con música de fondo, sus ilustraciones…-, también tendrían que tener ojo, porque en la mayoría de esos videos es fácil hacer referencia a o inspirarse en contenidos de terceros –frases, fotos, canciones-.

Quiero entender mejor el tema para luego explicárselo a mis iKids, porque espero que los tres aprendan a compartir contenidos originales, sabiendo crear y sabiendo acreditar. Y los tres quiero que entiendan que la responsabilidad no es siempre de otros, sino también de ellos. Como algunos aspectos se me escapan, he decidido preguntar a quien sí entienda, para que me lo explique.

Antonio Vargas, Public Policy Manager en Google España.

Antonio Vargas, Public Policy Manager en Google España.

iWomanish: Antonio, ¿qué representa para vosotros la actual redacción de la directiva?

Antonio Vargas: Cada día se suben más de 576.000.000 horas de video a YouTube. Si un solo minuto de esas horas incluye alguna violación de copyright, la actual redacción del artículo 13 implicaría responsabilidad directa para YouTube, que ni tendría conocimiento de ello.. Es una responsabilidad inasumible. Así que solo nos quedaría la opción de bloquear preventivamente muchos contenidos. La directiva marca que lo vigilemos y evitemos todo, pero nuestros algoritmos no entienden el contexto en el sentido del humor de una crítica o en una cita académica o informativa que, por ejemplo, deberían permitirse siempre.

iW: ¿Que pueden hacer las plataformas para velar por los derechos de autor?

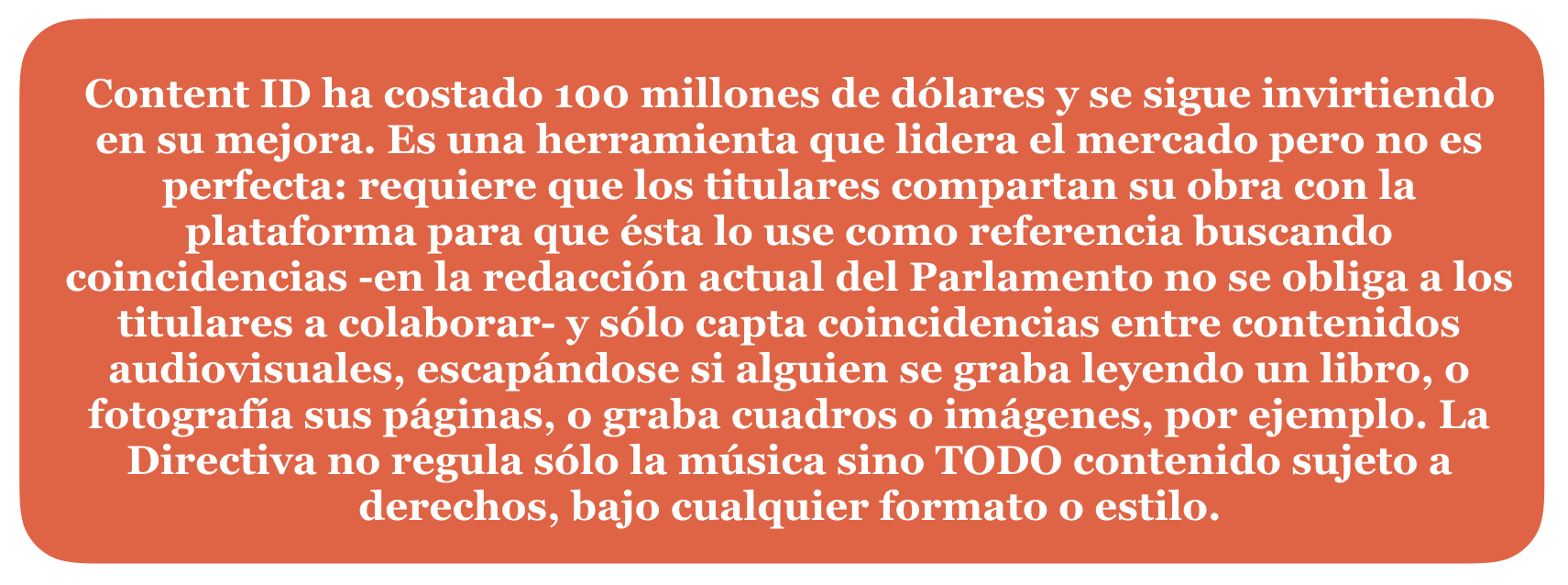

AV: Mucho, y ya lo hacemos. Nuestra obligación es retirar cualquier contenido ilícito -incluyendo el sujeto a derechos de autor compartido ilegítimamente- en cuanto se nos notifica y tenemos conocimiento efectivo de su ilicitud. Además, hemos creado una herramienta puntera en el mundo, Content ID, que busca coincidencias entre los archivos que nos entregan los titulares de derechos y todo lo disponible en la plataforma subido por otros usuarios; en caso de encontrar coincidencias, hacemos lo que diga el titular: permitirlo, bloquearlo o monetizarlo poniendo anuncios antes, y los ingresos los compartimos con los titulares de derechos y no con el usuario que ha subido el vídeo. En el 90% de los casos, los titulares escogen monetizar: por eso hay tantos contenidos sujetos a derechos de autor en la plataforma -siempre autorizados- y tantos anuncios.

iW: ¿Qué hace hasta ahora una plataforma como YouTube para concienciar a los usuarios sobre la importancia de acreditar autoría de contenidos ajenos?

AV: Cuando un autor se queja de que un contenido compartido vulnera sus derechos, YouTube hace lo que quieran los titulares, que casi siempre es añadir anuncios antes para obtener un beneficio por lo compartido por el usuario original, y así ganan todos. Por supuesto, también pueden bloquearlo, y el usuario puede reclamar que tiene permiso para compartirlo -por ejemplo, porque está citando con afán informativo y sin lucro, o por ser una parodia, como los memes. Ni Content ID ni ninguna tecnología entiende el contexto o la intención; eso solo puede hacerlo una persona y en caso de disputa no es YouTube sino un juez quien debe ponderar los derechos en conflicto.

Después de lo comentado, os dejo:

- una infografía que explica cómo funciona YouTube en términos de protección de derechos de autor.

- otra infografía desmonta algunos mitos sobre YouTube y esos derechos de autor.

Ofelia Tejerina, abogada, Master en Derecho Informático, Doctora en Derecho Constitucional por la UCM y experta en Tecnologías de la Información y Comunicaciones.

Ofelia Tejerina, abogada, Master en Derecho Informático, Doctora en Derecho Constitucional por la UCM y experta en Tecnologías de la Información y Comunicaciones.

iWomanish: Ofelia, como dirían mis iKids… ¿qué es esto del artículo 13?

Ofelia Tejerina: La Directiva lo que hace es imponer una responsabilidad directa a las plataformas online para el control de contenidos. Si un solo autor reclama y YouTube por ejemplo no retira, será sancionado. Y vale con que sea un presunto autor el que denuncia, aunque no presente pruebas “válidas en Derecho”de su autoría, porque ningún juez lo va a supervisar. El lenguaje jurídico es tan vago que no queda claro lo que tiene que hacer la plataforma, pero por lógica, lo que hará es borrar; eliminará el contenido en cuestión para evitarse problemas. Es lo mismo que pasó hace tiempo con los foros: cuando el Tribunal Supremo interpretó la responsabilidad directa de los administradores de los foros por los contenidos que editaban los usuarios, empezaron a desaparecer los foros.

iW: Entonces, ¿si yo subo un video a YouTube y viene un señor diciendo que le parece mal –porque se parece a algo suyo o porque le caigo mal o no está de acuerdo con el video y dice que le he copiado-, ante la denuncia YouTube elimina el video y si es reiterativo y llegan más denuncias me cierra el canal?

OT: Claro, es lo más práctico, porque es imposible asumir los costes y la logística de investigar. Antes podían, porque se les pedía colaborar ante una denuncia. Ahora no es que se les pida, es que se les impone responsabilidad total. Cualquiera puede ver algo en Internet y decir que es suyo… Se pone a las plataformas en la situación “elimina o te sanciono”. Lógicamente la plataforma puede plantearse esperar a defender contenidos en caso de creadores con una comunidad relevante. Pero si se trata de pequeños creadores, resulta difícil asumir la prevención, así que se optará por la eliminación. Ante la duda, borrar. Son empresas y actúan por criterios económicos, los criterios de justicia material son secundarios.

iW: ¿Las plataformas se quejan porque dejan de ganar dinero o porque les cuesta dinero o por qué?

OT: Las plataformas se quejan de que se les obliga a vigilar contenidos 24 horas, y aunque existen algoritmos para detectar posibles violaciones de copyright, que detectan parecidos manifiestos, no se llega a todo. Si la queja es que las plataformas ganan dinero por los contenidos de otros, la realidad es que las plataformas lo que permiten es que tú también puedas cobrar por tu trabajo y que se te conozca.

iW: ¿Y por qué tanto lío con el tema de que los usuarios europeos parece que se quedarán aislados de mucho contenido?

OT: Porque todo esto afecta a la hora de que un usuario europeo pueda acceder a contenidos que publica un youtuber en Estados Unidos, por ejemplo, o acceder desde fuera de Europa al canal de un creador europeo. La plataforma puede decidir bloquear el acceso desde Europa para evitarse problemas. Es lo mismo que pasa en China, donde no se pueden consultar determinados contenidos en Internet.

iW: Quizá muchos piensen que esta directiva, tal y como está redactada, afecta solo a los youtubers famosos. Pero digo yo que afecta también a una chica que hace fotografía y comporte fotos artísticas en Instagram. Si alguien dice que una de sus fotos se parece mucho a otra, y lo denuncia, cabe la posibilidad de que se bloquee su perfil. O a un chico que compone música y alguien considera que su canción se parece a otra y lo denuncia. ¿Esto es así?

OT: Es que la directiva no da mucha opción a las plataformas, es un “mejor borrar o si no, me la cargo”. Si un supuesto autor dice que has subido a Internet algo muy parecido a su obra y te denuncia a la plataforma, la directiva marca que, mientras se decide quién tiene razón, ese contenido tiene que desaparecer o la plataforma se arriesga a ser sancionada. Y no le compensa, lógicamente. Con todo esto, se limitan tanto la libertad para crear sin injerencias, como la libertad de expresión e información, sometidas exclusivamente a los derechos patrimoniales de algunos autores.

iW: ¿Son todopoderosos los algoritmos como para ser una herramienta eficaz para las plataformas a la hora de cumplir con la directiva?

OT: Un algoritmo no es exacto al 100% y la inteligencia artificial no puede solucionarlo todo. Con la tecnología actual, incluso con Content ID, es prácticamente imposible que las plataformas puedan hacer lo que exige esta directiva. Hoy por hoy, si creas unos acordes y alguien dice que se parece a una composición suya, se abren procesos de investigación e incluso se llega a pleito. Y hay pleitos activos porque la solución no está clara. Es difícil para personas, pero también para los algoritmos.

iW: Y con todo esto, ¿no se estaría dando más poder a las plataformas?

OT: Al imponer la total responsabilidad a las plataformas, se deja en sus manos decidir lo que sirve de prueba y lo que no, lo que es violación de copyright o no. La redacción inicial de la directiva en 2016 era más acorde con la realidad, implicaba colaboración. A la directiva actual le da igual quien sea el que comparte contenido y por qué lo hace: solo le importa que el contenido desaparezca. Y con inmediatez. Tal y como está redactado, no convence a casi nadie. A las plataformas, como empresarios que son, no les queda más remedio que responder eliminando contenidos. Nos quejamos de que las plataformas tengan poder, pero luego se les da aúnmás poder como este tipo de decisiones. Si la plataforma es quien está obligada a monitorizar todos los contenidos, les estamos convirtiendo en jueces y legisladores (ellas determinan el criterio).

iW: ¿Todo esto dónde deja a los jueces?

OT: Parece que como controlar Internet es muy difícil y como la justicia siempre va por detrás en legislar el mundo online, la solución es prescindir de los jueces y dar todo el poder de decisión a la plataforma sobre qué es contenido lícito o ilícito. Está bien tomar medidas cautelares ante una denuncia, pero con pruebas. Tiene que haber alguien capacitado para evaluar si hay o no infracción de derechos. Las redes ya deciden lo que vemos, también con algoritmos, y es algo frente a lo que deberíamos luchar. ¿Ahora también van a decidir lo que subimos a Internet? Pues les estamos obligando a eso. Parece que nos empeñamos en minar la responsabilidad de las personas.

Para terminar, te dejo un par de videos que explican el tema en un lenguaje más cercano a los iKids (el primero, para más mayores y el segundo, para algo más pequeños). Y así después hablas con ellos sobre autoría, sobre creación, sobre los límites de la libertad de expresión y sobre el enorme valor de utilizar Internet para ser creativo y no solo consumidor pasivo.

Jaime Altozano

Draw my life / TikTak Draw

Besos,

M.

PD. Solo cinco cosas más:

- La responsabilidad de los contenidos en Internet no debería ser solo de las plataformas, sino también de los usuarios. Y en derechos de autor, es imprescindible la colaboración de los titulares para identificar sus obras.

- Quizá podemos educar para que las nuevas generaciones se acostumbren a acreditar la autoría ajena cuando recurren a ella.

- Que no esté de acuerdo con la redacción actual de la Directiva no quiere decir que no apoye los derechos de autor. Soy muy pesada hablando con jóvenes sobre respetar y acreditar la autoría de contenidos. Y soy defensora de defender a quien crea contenidos originales. Pero también considero que hay muchas maneras de utilizar contenidos sin que se produzca plagio.

- Márcate un postureo total hoy en la cena hablando con tus iKids sobre el artículo 13.

- iFirst, te dedico este post con todo mi amor… Léelo y luego hablamos 😉

Mil gracias María. No se puede dejar más claro. ¡¡¡Tremendo curro!!!

Gracias a ti por leerlo, Santi. Un abrazo!